スマートフォンやスマートスピーカーで使うSiriは、日常的な操作では便利ですが、最近の大規模言語モデル(LLM)と比べると「生成AI」としての応答の精度や創造性で劣る場面が目立ちます。本記事では、技術的背景と設計方針、利用環境の制約からなぜそうなるのかを丁寧に掘り下げ、利用者が現状でできる工夫やAppleが取り得る改善策まで紹介します。

Siriが抱える基本的な制約

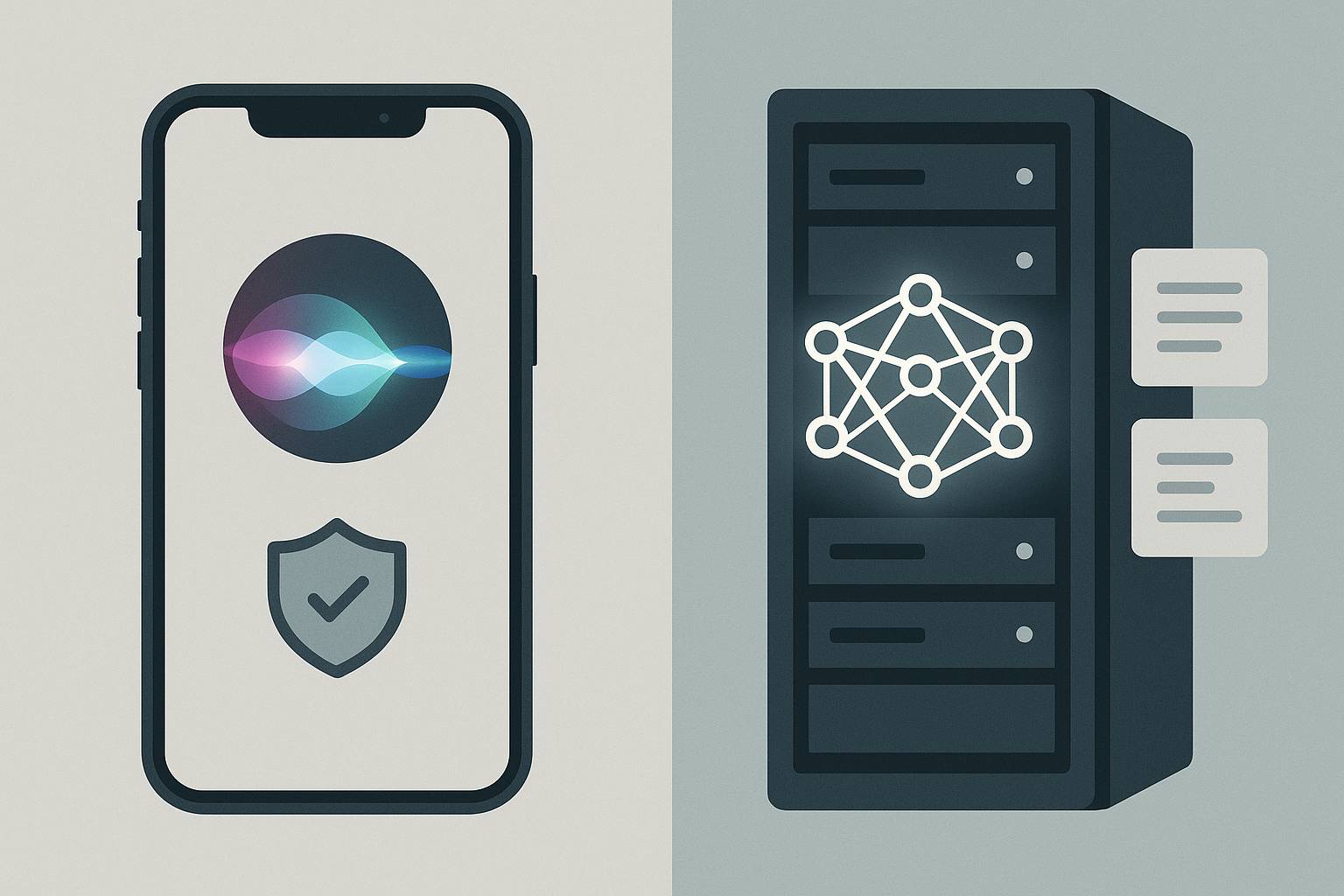

まず抑えておきたいのは、Siriは単に「話しかけて答える」以上の要件で設計されているという点です。プライバシー重視、低遅延でのデバイス連携、省電力な動作などが優先されるため、純粋な生成能力を最大化する設計になっていません。

具体的には以下の点が制約になります。

- オンデバイス優先:データを端末内で処理することが多く、巨大モデルをサーバーで常時呼び出せない。

- 計算リソースの制限:スマホやスピーカー内のチップでは大規模モデルを高速に動かせない。

- プライバシー設計:ユーザーデータを使った大規模な学習やログ収集が制限されている。

- 開発者向けAPIの制約:サードパーティの拡張が限られ、外部モデルやツールとの連携が難しい。

LLM(大規模言語モデル)との違い

一般的な生成AI(例:GPT系、Claude、PaLMなど)は、非常に大きな学習データと高性能なサーバーサイドGPUを前提に設計されています。これにより長い文脈を保持したり、創造的な文章生成、複雑な推論が可能です。一方でSiriは、短いコマンド処理やタスク実行を優先するため、同等の「生成力」は得にくいのです。

端末性能と遅延(レイテンシ)のトレードオフ

高速な生成応答のためには大きな計算量が必要で、これをサーバー側で行うとネットワーク遅延が発生します。ユーザー体験としては「即時に反応する」ことが重要なので、Siriは応答の速さと正確さのバランスを取る設計になっています。結果として、複雑な生成タスクに時間をかけられず、簡潔で安全な回答に傾きます。

プライバシー優先がもたらす制約

Appleはユーザーのプライバシーを重要視しています。音声データの取り扱いやログ保存の制限は、モデルの継続的改善や大規模データによる微調整(ファインチューニング)を難しくします。多くの生成AIは巨大なログを学習に使って能力を伸ばしますが、Siriはその面で不利です。

設計方針とビジネスの優先順位

Appleはプロダクト体験の一貫性やセキュリティを重視します。生成AIの「自由な発想」よりも、誤情報を出さない・ユーザーの操作を誤らせないことを優先するため、出力の抑制や簡潔化が行われます。これはビジネス判断であり、必ずしも技術的に不可能だからではありません。

音声認識(ASR)と自然言語理解(NLU)の限界

Siriの応答品質は、音声認識と意図理解の精度にも依存します。雑音下や方言、長い会話の文脈を正確に捉えるのは難しく、誤認識が原因で生成の土台がぶれることがあります。音声→テキスト→意図解析→応答生成の各工程で小さな誤差が積み重なります。

Siriと生成AIの比較表

| 項目 | Siri | 一般的なLLM(例:GPT) |

|---|---|---|

| モデル規模 | 小〜中(端末向け最適化) | 大(数十億〜数兆パラメータ) |

| 文脈長 | 短め | 長め(数千トークン) |

| プライバシー | 高優先(端末処理重視) | サービス次第(ログ利用あり得る) |

| カスタマイズ性 | 限定的 | 高い(プロンプト設計やファインチューニング可) |

| 生成の創造性 | 控えめ | 高い |

ユーザーができる工夫(今すぐ使える対策)

Siriをより賢く使うための具体的なコツを挙げます。

- はっきりと短く指示する。長い背景説明を省き、目的を明確にする。

- 連続した文脈が必要な場合は、直前の発言を短くまとめてから再質問する。

- ショートカット(Shortcuts)を活用して定型処理を任せることで、Siriの得意分野を広げる。

- 必要に応じてテキストベースのLLMと組み合わせる(メモや外部アプリで生成→Siriに実行させる)。

Appleが取り得る技術的改善案

将来的にSiriの生成力を上げる技術的方向性は複数あります。いくつか紹介します。

- ハイブリッドアーキテクチャ:簡単な処理はオンデバイスで、高度な生成は安全性担保の上でサーバー側LLMを利用する。

- プライバシー保護型の学習:フェデレーテッドラーニングや差分プライバシーを使って、個人データを漏らさずにモデルを改善する。

- RAG(取得強化生成):信頼できる外部データソースを参照して事実性の高い応答を返す。

- モデル蒸留(distillation):大規模モデルの知識を小型モデルに移す手法で、端末で高性能を実現する。

- 開発者向けAPIの拡充:外部ツールとの連携やカスタムスキルを増やす。

まとめ:設計上の選択がSiriを「弱く」見せる

結論として、Siriが生成AIとして弱く見えるのは単に技術力不足ではなく、設計方針と実運用上の制約によるものです。プライバシー保護、応答速度、デバイス連携の優先度が高いため、創造的で長文生成に特化したLLMとは性質が異なります。ただし、技術的な解決策は存在し、Appleが段階的に導入すればギャップは縮まります。

現状のSiriを賢く使うには、短く明確な指示、ショートカットの活用、必要時に外部LLMを使うなどの工夫が有効です。開発者やユーザーからのフィードバックが増えれば、将来的な改善も加速するでしょう。

[editor_balloon id=”5″]

担当のひとこと:Siriは基本的にお天気を聞くか音楽操作の補助くらいでしか使ってこなかったので生成AIというイメージじゃないですね。[/editor_balloon]